AMD 與 Stability AI 合作推出全球首款支援 BF16 的 NPU 模型「SD 3 Medium」,專為 XDNA 2 架構設計,能在 Ryzen AI 筆電上以更少記憶體實現高品質圖像生成,效率與畫質兼具,將 AI 模型本地化推向新高度。

支援 SD 3 Medium 的 NPU 模型正式登場

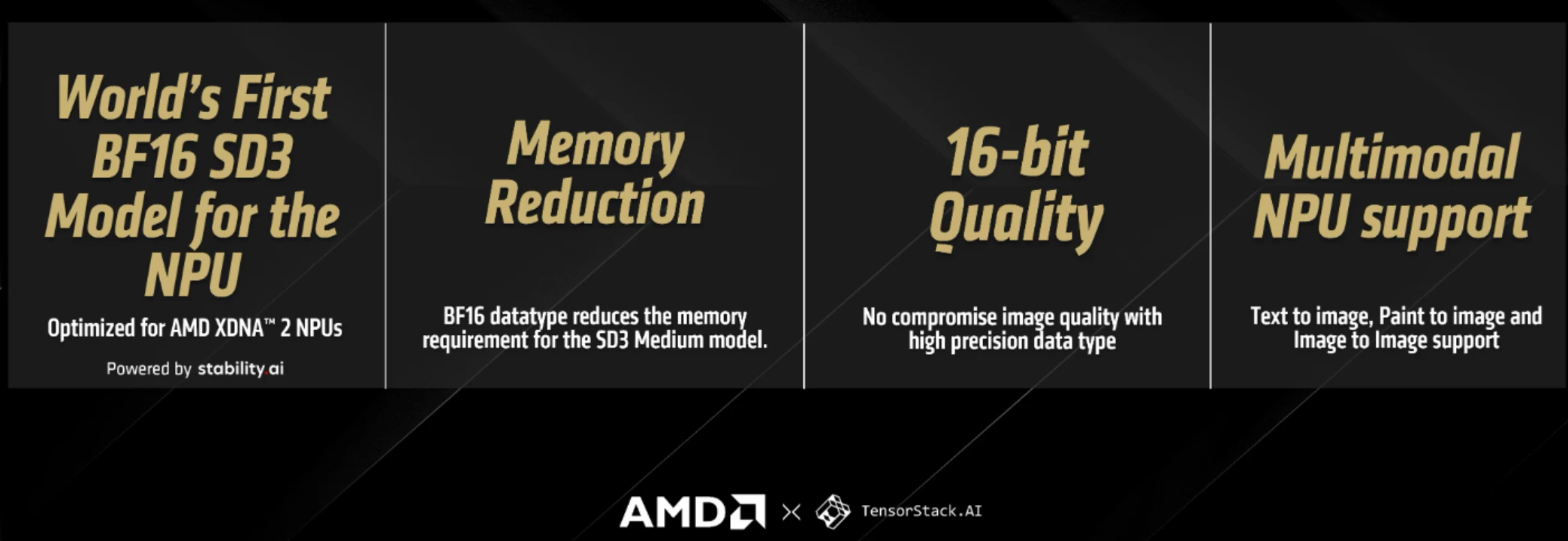

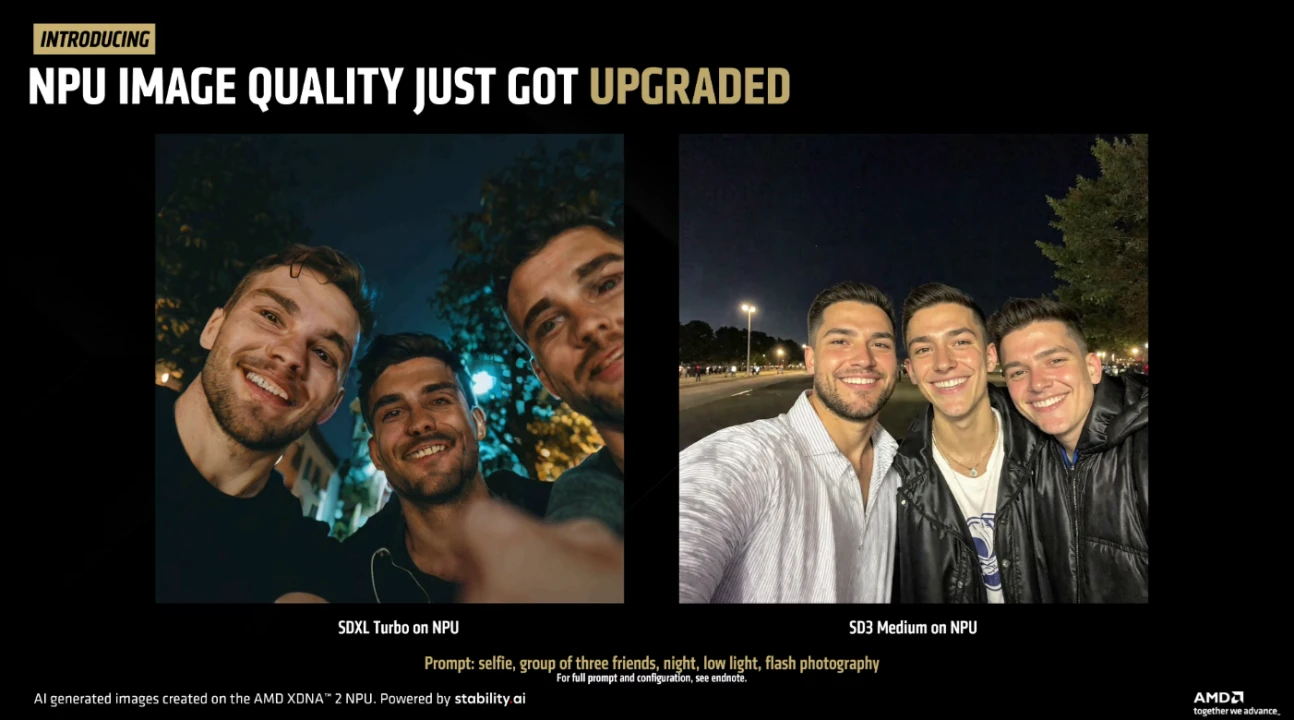

繼去年的 Computex 後,AMD 又再度與 Stability AI 聯手,推出全球首款支援 Block FP16 (BF16) 格式的 NPU AI 模型「SD 3 Medium」。該模型專為 XDNA 2 架構最佳化,讓 AI 圖像生成任務不再需要仰賴雲端資源,直接在筆電本地端完成,畫質與速度均達高標。

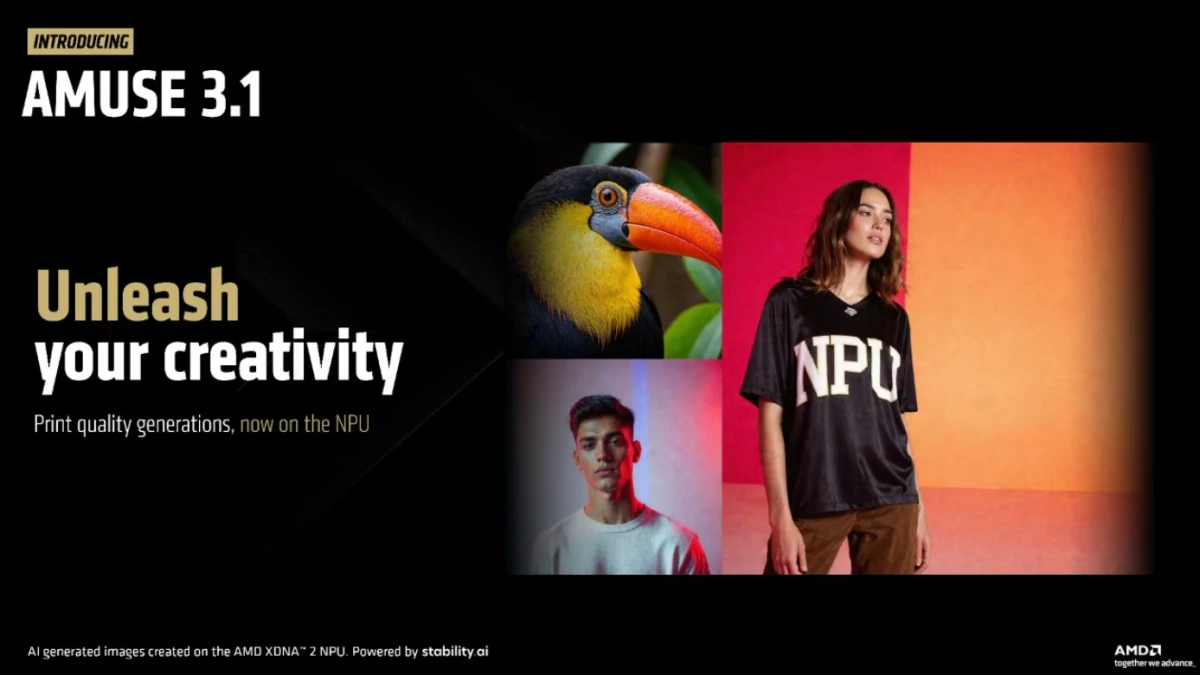

這項模型是「Stable Diffusion 3」家族的中階版本,專為效能與資源使用達到平衡設計,首度出現在 Tensorstack 的 Amuse 3.1 工具套件中。用戶只需在符合條件的 Ryzen AI 筆電上安裝相關軟體,即可使用此模型進行高品質文字轉圖像 (Text-to-Image) 生成任務。

SD 3 Medium 在技術上結合了 BF16 的高精度與近似 INT8 的效能表現,使其運作更有效率且減少資源需求。與過去需要 32GB 或以上記憶體的模型相比,該模型僅需 24GB RAM 且實際使用僅 9GB,在效能與畫質間取得理想平衡。

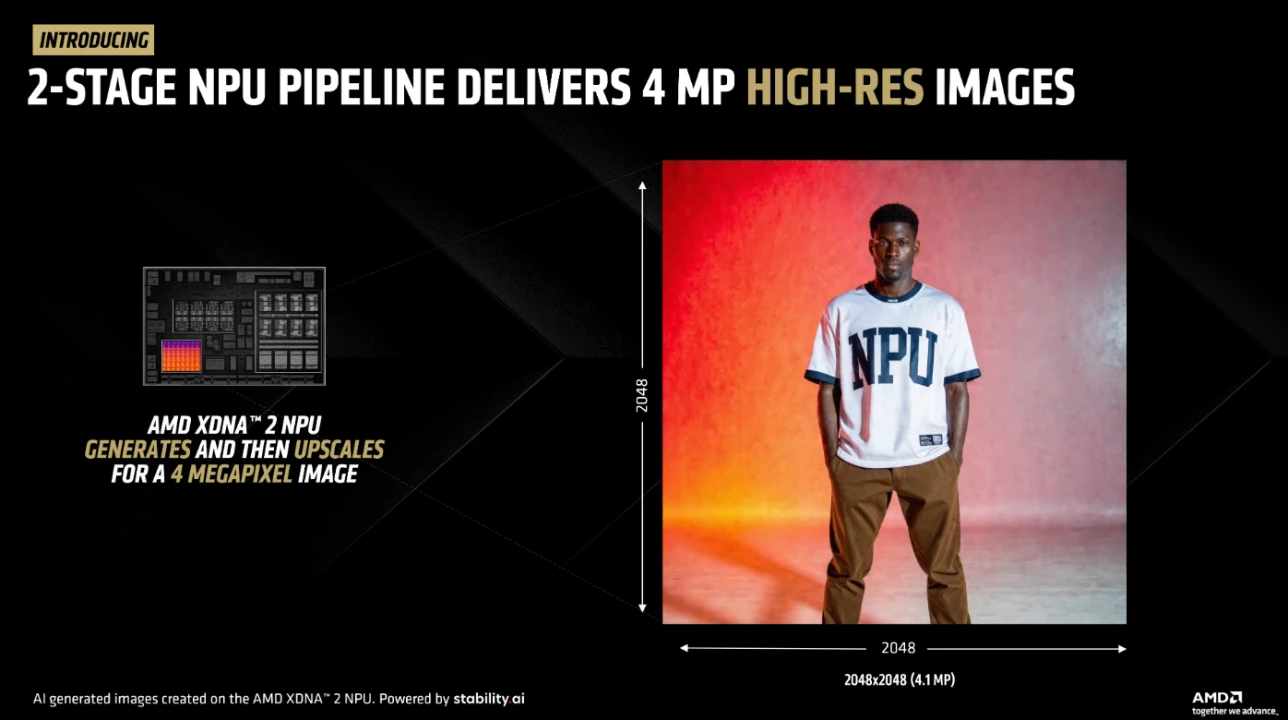

此外,藉由 AMD XDNA 2 的雙階段運算流程 (2-stage pipeline),原始 1024 x 1024 的圖像會自動超解析至 2048 x 2048,達到 4MP 印刷等級品質,可應用於品牌視覺、社群行銷或素材快速生成。

得益於 Ryzen AI XDNA 2 NPU 的 50 TOPs AI 運算能力,用戶可完全在本地端執行 AI 任務,不再需要連接 Wi-Fi 或支付雲端訂閱費。這樣的設計不僅提升隱私與安全,也特別適合移動工作、創作設計或對效能有即時需求的工作者。

你現在就能透過以下方式親自體驗 SD 3 Medium 模型:

-

擁有 Ryzen AI 300 系列或 MAX+ 筆電 (需至少 24GB RAM、XDNA 2 NPU)。

-

安裝最新 AMD Adrenalin 驅動程式。

-

下載並安裝 Amuse 3.1 Beta。

-

啟用 HQ 模式,勾選「XDNA 2 Stable Diffusion Offload」設定。

SD 3 Medium 模型的推出,代表 AI 圖像生成不再是雲端的專利。AMD 與 Stability AI 聯手打造的這項技術,不僅顛覆 AI 執行的效能瓶頸,也擴大了 AI 內容創作的可能性。這對設計師、開發者與內容創作者而言,都是一次創新突破。

延伸閱讀