NVIDIA (輝達) 今天推出第八代人工智慧 (AI) 軟體 TensorRT 8,讓語言查詢的推論時間減半,並讓開發人員得以打造全世界最高效能的搜尋引擎、廣告建議與聊天機器人,並能從雲端到邊緣提供這些服務。

NVIDIA (輝達) 今天推出第八代人工智慧 (AI) 軟體 TensorRT 8,讓語言查詢的推論時間減半,並讓開發人員得以打造全世界最高效能的搜尋引擎、廣告建議與聊天機器人,並能從雲端到邊緣提供這些服務。

NVIDIA 推出第八代人工智慧軟體 TensorRT 8

TensorRT 8 的優化只需要 1.2 毫秒就能在 BERT-Large 上達到破紀錄的語言應用速度,而 BERT-Large 是全世界最被廣泛使用的 Transformer 模型之一。企業以往只能縮小模型的大小,但也因此造成較低的精準度,如今有了 TensorRT 8,企業可以把模型的大小擴增兩倍或三倍,並大幅提升精準度。

NVIDIA 開發人員計劃事業部副總裁 Greg Estes 表示:「AI 模型正以指數級的速度變得越來越複雜,而全球各地對於使用 AI 的即時應用需求也隨之高漲。這讓企業迫切地部署最新的推論解決方案。最新版本的 TensorRT 導入全新的功能,可以讓企業把對話式 AI 應用交付給客戶,並達到過去無法企及的品質水準和反應速度。」

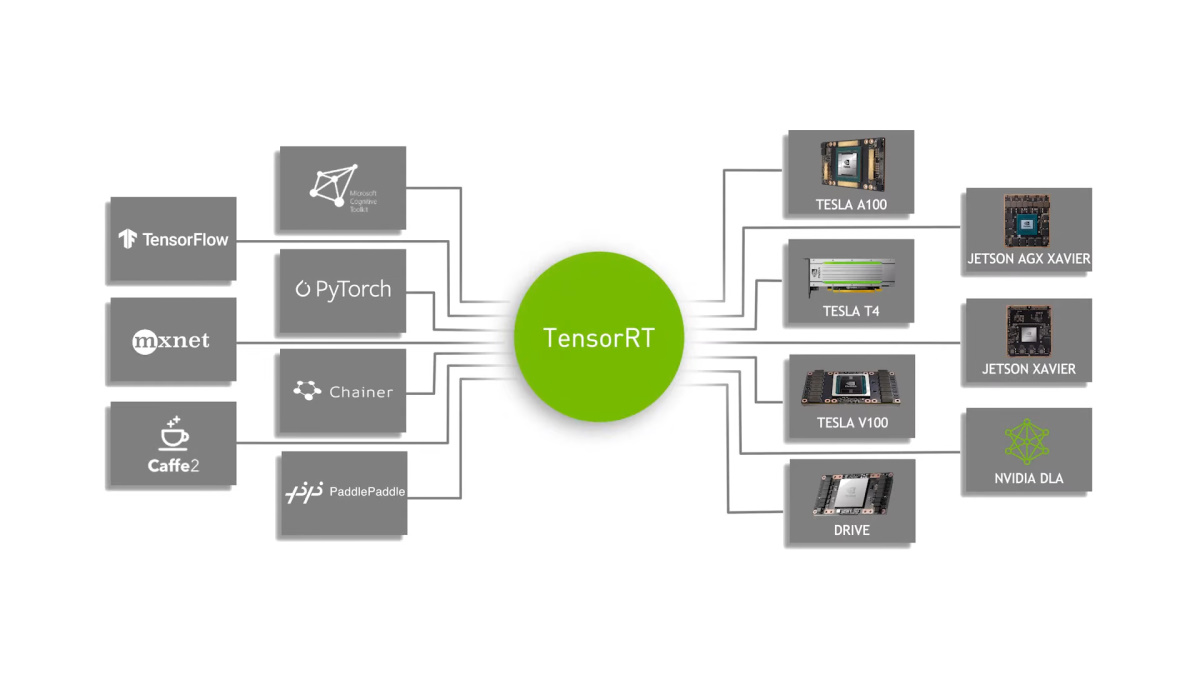

來自醫療照護、汽車、金融與零售業等各領域的 2.75 萬家公司、超過 35 萬名開發人員,在過去五年已經累積近 250 萬次的 TensorRT 下載量。TensorRT 的應用可以部署在超大規模資料中心、嵌入式或汽車產品平台。

最新的推論創新

除了 Transformer 的優化,TensorRT 8 還透過另外兩個關鍵功能達成 AI 推論的突破。

稀疏性 (sparsity) 是 NVIDIA Ampere 架構 GPU 中用以提升效率的效能技術,可以讓開發人員藉由減少運算作業以加速神經網路。

量化感知訓練讓開發人員可以在不犧牲精準度的情況下,運用已訓練好的模型和 INT8 的精度運行推論,這讓他們在 Tensor 核心上進行高效率推論時,可以大幅減少運算與儲存的時間。

廣泛的業界支持

各產業的領導業者紛紛採用 TensorRT 打造對話式 AI 與各種領域的深度學習推論應用。

Hugging Face 是全球各產業的 AI 服務供應商所仰賴的開源 AI 頂尖企業,該公司與 NVIDIA 密切合作,以導入能大規模執行文字分析、神經搜尋與對話式應用的開創性 AI 服務。

Hugging Face 產品總監 Jeff Boudier 表示:「我們與 NVIDIA 密切合作,在 NVIDIA GPU 上運行最新的模型並達到最高效能。Hugging Face Accelerated Inference API 已經為透過 NVIDIA GPU 驅動的 Transformer 模型提升高達一百倍的速度。有了 TensorRT 8,Hugging Face 在 BERT 上可達到僅一毫秒的推論延遲,我們也很興奮將在今年稍晚提供這樣的高效能服務給客戶。」

提供醫療技術、診斷學及數位解決方案的創新國際企業 GE Healthcare 正使用 TensorRT 協助加速超音波的電腦視覺應用。超音波是疾病初期檢測的重要工具,此應用可以讓臨床醫師透過該公司的智慧醫療照護解決方案,提供最高品質的照護服務。

GE Healthcare 心血管超音波事業部總工程師 Erik Steen 表示:「談到超音波,臨床醫師總得耗費寶貴的時間挑選並測量影像。在 Vivid Patient Care Elevated Release 的研發前期,我們希望在 Vivid E95 超音波掃描儀上實作自動化心臟檢查,讓整個流程更有效率。心臟辨識演算法會選擇適當的影像進行心臟壁動作分析,TensorRT 具備即時的推論能力,可以提升檢測演算法的效能,同時縮短研發專案的產品上市時程。」

供應時程

TensorRT 8 已正式推出並提供 NVIDIA 開發人員計劃成員免費使用。最新版本的外掛程式、剖析器與範例,也以開源碼的方式放在 TensorRT GitHub 儲存庫供取用。